图游走类模型

图游走类模型

# 1、图游走类算法简介

目标:Node embeddings。得到节点的低维表示,学习到节点与邻居的关系,更好地表示节点信息,再用于下游任务

方法:多次游走,得到游走序列,类似于NLP领域的Word2vec模型:词的语义由其上下文决定

# 2、Word2vec

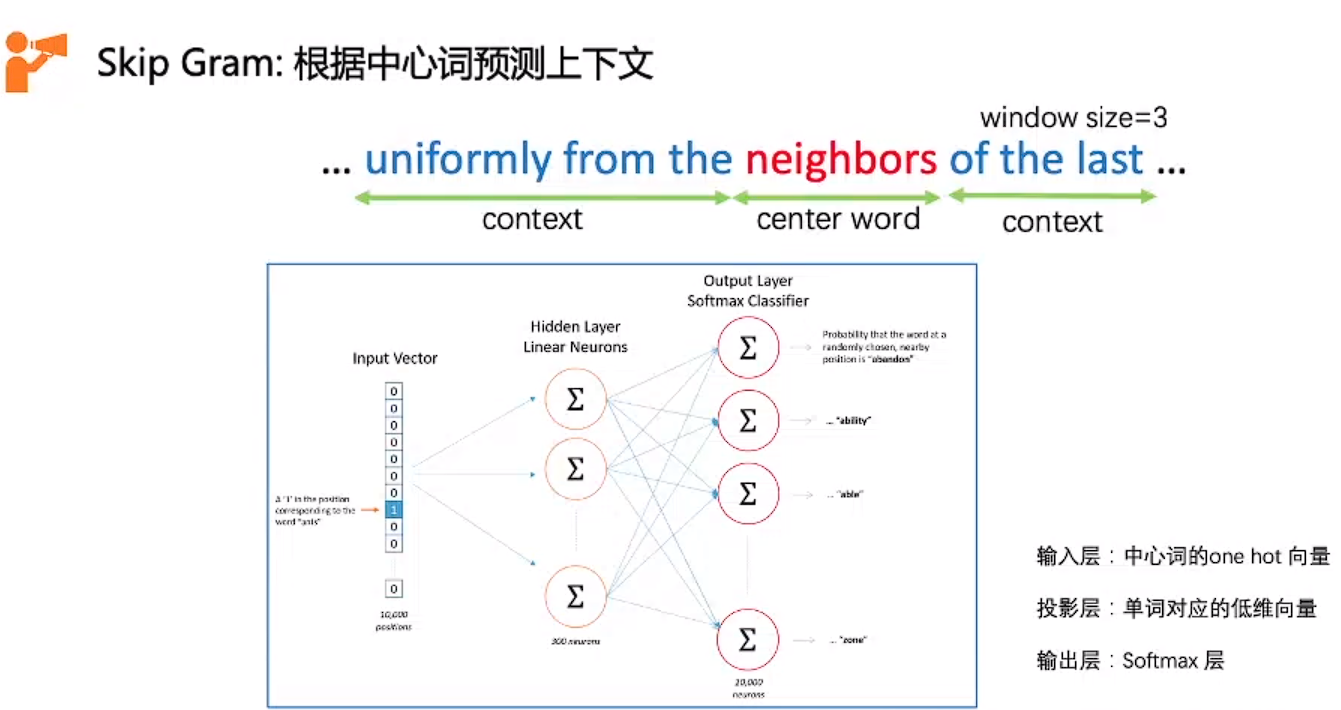

# 2.1 Word2vec:Skip Gram

通过给定中心词预测上下文这个任务,得到Hidden layer的参数,通过Hidden Layer即可得到词的Embedding。

# 2.2 Word2vec:Negative Sampling

softmax需要对上下文的每个词都预测一个概率,计算量很大

提出负采样(Negative Sampling),得到正样本和负样本,做一个分类任务,将 Softmax 变为 Multiple sigmoid

# 3、Word2vec->图浅入领域

# 3.1 图游走类模型-DeepWalk

通过随机游走得到NLP领域中的“句子”,得到多个游走序列,本质就是可以回头的DFS

15:50

上次更新: 2021/08/17, 18:07:06

- 02

- README 美化05-20

- 03

- 常见 Tricks 代码片段05-12