Puzzle-CAM Improved localization via matching partial and full features

Puzzle-CAM Improved localization via matching partial and full features

# Puzzle-CAM: Improved localization via matching partial and full features

# 单位:KAIST

# 作者:Sanghyun Jo, In-Jae Yu

# 发表:ICIP 2021

# 摘要

弱监督语义分割(WSSS)出于缩小像素级监督和图像级监督性能差距的目的而提出。许多方法都基于类激活图(CAMs)来生成伪标签以训练分割网络。WSSS 的主要缺陷是使用图像分类器的 CAMs 会主要关注目标最具判别力的地方。为了解决这个问题,作者提出了 Puzzle-CAM,用于最小化图像部分和整图的差异。我们的方法由一个 puzzle 模块以及两个正则化机制来找到物体较为完整的部分。Puzzle-CAM 能够基于图像级别的监督信号激活物体的整个区域,而不需要额外的参数。在实验中,Puzzle-CAM 在PASCAL VOC 2012 数据及上达到了 sota 的结果。

# 阅读

# 论文的目的及结论

该篇论文希望改进 CAM 算法,让网络能够激活物体完整的部分,而不仅仅是较易判别的部分。最终可以达到PASCAL VOC 2012数据集上 sota 的结果。

# 论文的实验

4.1 实施细节

PASCAL VOC 2012 数据集被划分为 1464 张图像作为训练集,1449张图像作为验证集,1456张图像作为测试集,follow 了[4,5,6] 中的实验设置,从 [15] 中建立了一个额外的包含 10582 张图像的训练集。图像被随机 Resize 到 [320,640] 的尺寸,然后 crop 到 用作网络输出。对于所有的实验,设置 作为最大值,并通过半个 epoch 将 线性地升至最大值。在推理阶段,利用不带 puzzle 模块的分类。因此作者作者用多尺度以及水平翻转来生成分割的伪标签。使用 TITAN-RTX GPU 来训练数据集。

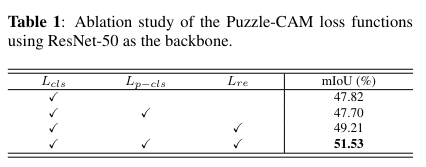

4.2 消融实验

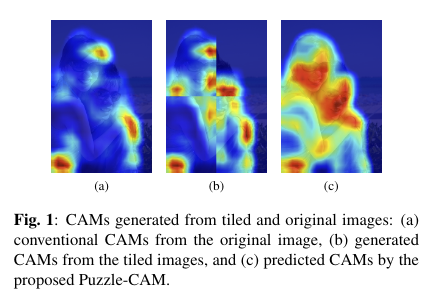

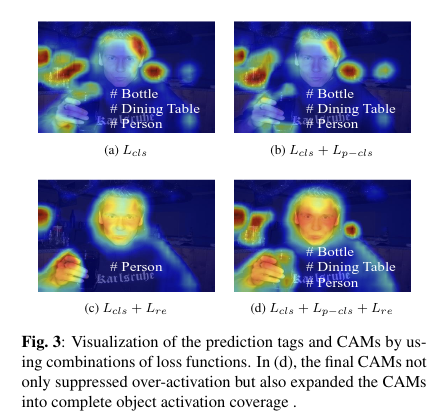

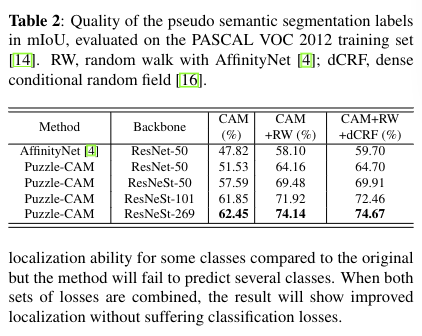

作者对提出的两个正则化loss 做了消融实验,发现在最终生成的CAMs 上都有不同程度的提升。Baseline 的 是 47.82%,单独加入 之后的 是 49.21%(提升了1.39%),单独加入 的 和Baseline 相当,同时加入 和 之后 能够提升 3.71%。图一和图三的可视化结果也能够说明这一点。

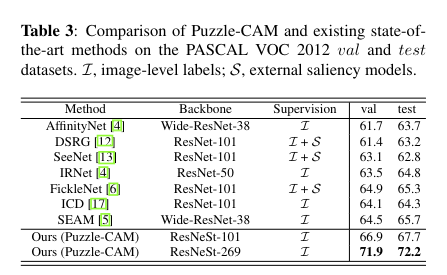

4.3 与 SOTA 的方法比较

作者的实验设置是基于 Puzzle-CAM 来训练 AffinityNet ,采用Resnest 架构来提升网络的特征提取能力。为了进一步改进伪分割标签的精度,follow了 [4] 中的实验设置来训练 AffinityNet。最终的伪标签能够在PASCAL VOC 2012 的训练集上达到 74.67% 的 ,表 2 展示了原始 CAMs 和 Puzzle-CAM 的性能。

使用 ResNeSt-269 Backbone 的 DeepLabv3+ 算法以全监督的方式得到最终的分割结果。表 3 展示了和其他方法的比较, 表示 image-level 的标签, 表示额外的显著性模型。

# 论文的方法

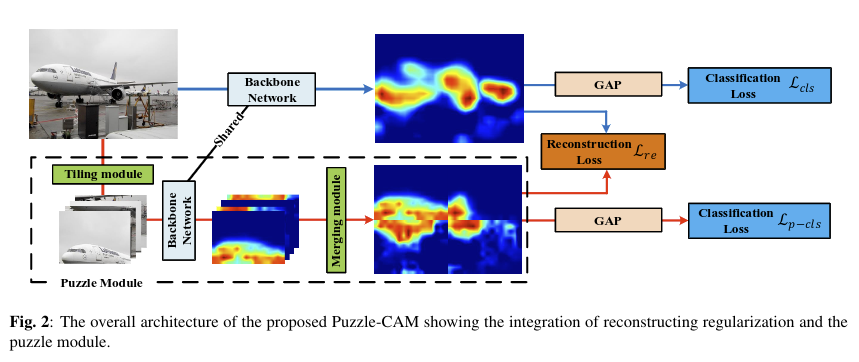

3.1 Puzzle 模块

Puzzle 模块由分割模块(Tiling module)和合并模块(merging module)组成,对于尺寸为 的图像 而言,分割模块会生成四张无重复的尺寸为 的图像块 {} ,然后对每个图像块都生成 CAMs,最后合并模块将四张图像块再拼到一起

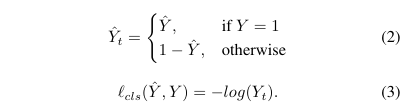

3.2 Puzzle-CAM 模块的损失函数

第一部分对针对多标签图像分诶任务而言会有一个soft margin loss ,公式如上。原始的 CAMs 定义为 ,通过 Puzzle 模块生成的 CAMs 定义为 ,使用 GAP 层转换得到 和 ,由这两个可以得到两个损失项,称为 以及 。这两个分类的损失用于改善图像分类的性能,为了原始图像的 CAMs,作者添加了重构正则化,原始 CAM 的重构损失被定义为 。

最终将这三项损失结合到一起我们可以得到最终的 Puzzle-CAM 的损失函数:

是损失平衡权重,分类损失 和 被用于估计目标的区域,重建损失 被用于缩小像素级和图像级的监督信号的差距,

# 总结

# 论文的贡献

论文主要是针对弱监督语义分割提出了 Puzzle 模块,将原始图像分块后再算一个CAMs,并与原始的 CAMs 做一个重建损失,三项损失联合优化分类网络,提升 CAMs 的精度。

该论文着眼于改进半监督语义分割的 Image-level 样本的利用方式,作者使用共享 Backbone 和 Neck的双分支网络,分为 Strong 分支以及 Weak 分支,将强监督样本送入 Strong 分支,将弱监督样本送入 Weak 分支,可以较好的消除监督不一致的现象,有助于缓解强弱样本不平衡问题。训练完成后,弱分支就不再需要了,其在训练过程中起到正则化的作用,加强了 Backbone 以及 Neck 网络的泛化能力

# 论文的不足

# 论文如何讲故事

# 参考资料

https://arxiv.org/abs/2101.11253

https://github.com/OFRIN/PuzzleCAM

- 02

- README 美化05-20

- 03

- 常见 Tricks 代码片段05-12